De aprobarse sin cambios el proyecto la Ley de Presupuesto, Uruguay se encuentra a punto de construir una base de datos de «Identificación Facial» para su tratamiento con fines de seguridad pública a cargo de la Secretaría del Ministerio del Interior (artículo 181 del Proyecto Ley de Presupuesto Nacional 2020-2024). Para la construcción de esta base, se prevé migrar a la Secretaría del Ministerio del Interior la base de datos que actualmente se encuentra a cargo de la Dirección Nacional de Identificación Civil encargada de emitir la cédula de identidad. La base incluye: la totalidad de las imágenes faciales de las personas mayores de edad de las que lleva registro, los nombres y apellidos de sus titulares, sexo, fecha de nacimiento, nacionalidad, número de cédula de identidad, fecha de expedición y fecha de expiración de esta última (artículo 182 del Proyecto Ley de Presupuesto Nacional 2020-2024).

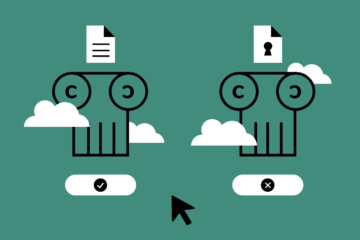

El pasado 13 de octubre estos dos artículos fueron aprobados por la Cámara de Representantes sin ningún tipo de debate. Esto es algo que nos parece al menos curioso, porque hay muchos aspectos sin definir como por ejemplo los usos que tendrá la base o el marco de garantías para su uso. El concepto de “seguridad pública” es amplio y poco define los límites de las autoridades públicas para hacer uso de datos personales. La legislación debería garantizar la transparencia en cómo se va a usar la base, establecer los procedimientos y los mecanismos de supervisión adecuados para preservar la privacidad de las personas y otros derechos fundamentales como la libertad de expresión.

El Ministerio del Interior cuenta hoy con un sistema de 8433 cámaras distribuidas en los 19 departamentos del país, además de los sistemas de vigilancia privada, por lo que resulta natural pensar que el uso que el Ministerio pretende dar a esta base de identificación facial es la de vigilancia automatizada mediante algoritmos de reconocimiento facial, tecnología disponible y ofrecida por varias empresas comerciales. Además, probablemente no es casual que este mismo Proyecto Ley de Presupuesto agregue la definición de “datos biométricos” (artículo 79) a la Ley de Protección de Datos Personales.

¿Qué puede salir mal?

Varios estudios recientes [1], [2], [3] advierten que la mayoría de los sistemas de reconocimiento facial comerciales tienen sesgos importantes y demuestran ser tecnologías aún inmaduras. La tecnología de reconocimiento facial sesgada es particularmente problemática para usos relacionados con seguridad pública porque los errores podrían dar lugar a acusaciones falsas y arrestos injustificados. Analizando estas investigaciones encontramos que la tasa de precisión para la identificación de rostros femeninos y de piel más oscura suele ser mucho más baja que la de los rostros masculinos blancos. La precisión también es baja en diferentes franjas de edad, principalmente en niños y adultos mayores. En Londres, 8 ensayos llevados a cabo entre 2016 y 2018 dieron como resultado una tasa del 96% de falsos positivos en su sistema metropolitano de reconocimiento facial, siendo especialmente relevante el problema de la detención de niños afrodescendientes falsamente detectados como presuntos criminales.

La alta tasa de falsos positivos puede deberse a varios factores, entre ellos: (1) que los datos de entrenamiento de los algoritmos deben tomar de forma muy precisa los aspectos de paridad demográfica y deben ser entrenados con sets de datos contextualizados a la realidad en la que operará el software, y (2) que para evitar errores no basta con un algoritmo eficiente; la base de datos de identificación facial debe gestionarse con altos niveles de eficiencia técnica, ya que cualquier error podría desencadenar una prohibición de libertad injustificada. Es por ello que cabe preguntarse, ¿Se tomarán en Uruguay estas previsiones? ¿Con qué datos serán entrenados los algoritmos? ¿qué medidas de seguridad aplicarán a la base de datos cuando se comience a utilizar para la “seguridad pública”?

Para comprender los riesgos basta con mirar el ejemplo de Argentina. En abril de 2019, el gobierno de la ciudad de Buenos Aires introduce el Sistema de Reconocimiento Facial de Prófugos (SRFP). Se trata del software UltraIP ofrecido por la empresa DANAIDE SA que analiza los videos de las cámaras situadas en los trenes, el subte o lugares cercanos señalando posibles coincidencias de rostros con personas incluidas en una base denominada Consulta Nacional de Rebeldías y Capturas – CONARC (Registro Nacional de Fugitivos y Arrestos). Como la base del CONARC no incluye fotos de los presuntos delincuentes, las fotos de referencia se extraen del registro de población del país.

Desde que el sistema está funcionando no se ha creado un protocolo policial de gestión para este tipo de arrestos y se han denunciado numerosos arrestos erróneos y detenciones (por varios días) de personas mal identificadas. Las organizaciones ADC (Asociación por los Derechos Civiles) y Human Rights Watch alertan sobre varias desprolijidades en el manejo del “Registro Nacional de Fugitivos y Arrestos”, como datos faltantes en la base, errores de tipeo y otros errores que desembocan en la confusión de identidad, además de la inexplicable inclusión de 166 niños en la base de prófugos.

La vigilancia facial es peligrosa cuando funciona y cuando no

Ahora bien, supongamos que los algoritmos de reconocimiento facial funcionan correctamente y que la base es gestionada prolijamente desde el punto de vista técnico por parte de la Secretaría del Ministerio del Interior uruguayo. Eso significaría que los sistemas de vigilancia estatales podrían identificar a cada persona a la perfección. En este caso la pregunta es: ¿realmente queremos ir hacia allí?

Mientras que en Uruguay el tema se incluye en una Ley de Presupuesto (ley ómnibus) y sin discusión pública, en otros países los parlamentarios proponen o incluso aprueban leyes prohibiendo el uso de reconocimiento facial por parte del gobierno para vigilar a sus ciudadanos [1] [2] [3] [4] [5] [6], incluyendo la prohibición del uso de otras tecnologías biométricas como el reconocimiento de voz, el reconocimiento de la marcha y el reconocimiento de otras características físicas inmutables. Varias organizaciones que trabajan en temas de derechos humanos y tecnología en América Latina vienen relevando los casos problemáticos de uso de reconocimiento facial y alertando sobre los riesgos que esta tecnología representa para la población. Desde la campaña regional reconocimientofacial.info presentan contundentes argumentos para oponerse al reconocimiento facial.

Esta tecnología puede ser utilizada para encontrar y arrestar manifestantes u organizadores de protestas o puede usarse para rastrear a personas a distancia sin su conocimiento, entre otros usos preocupantes. Además, vivir en una sociedad vigilada afecta la privacidad de las personas y también afecta la libertad de expresión, de movimiento y de reunión, de formas aún no sospechadas. ¿Cómo afectará la identificación facial el comportamiento de los uruguayos? ¿Se han realizado análisis de impacto sobre las posibles consecuencias sociales del uso de la biometría en el espacio público? ¿Es necesario y proporcional? Estas son algunas de las preguntas que deberíamos hacernos considerando que los nuevos usos pueden tener un gran impacto en derechos fundamentales.

Sobre la posibilidad de tratar el tema democráticamente

Entendemos que, al menos, deberíamos contar con la oportunidad de llevar adelante un debate público sobre este tema. Si luego de un debate social y parlamentario adecuado, se decide la pertinencia de la existencia de una base de identificación facial y su uso, será fundamental contar con protocolos, medidas de auditoría, transparencia y políticas estrictas contra el abuso.

Finalmente resaltamos que resulta inoportuna la inclusión de este tema en el marco de un proyecto de ley que por sus plazos de tramitación no permite una adecuada discusión parlamentaria. Si este debate no sucede antes de que se apruebe el proyecto de ley y si se aprueban estos artículos 181 y 182 sin más trámite, son muy bajas las posibilidades de incidir en el tema ya que el Ministerio del Interior se ha negado sistemáticamente a responder las solicitudes de acceso a la información pública referidas a temas de seguridad. Esto sucedió, por ejemplo, con las solicitudes de acceso a la información pública sobre la herramienta de interceptación de comunicaciones El Guardián o sobre el software usado entre 2013 y 2017 como apoyo al despliegue de recursos de patrullaje PredPol.

1 comentario

Leonardo Quintana · 2 de noviembre de 2020 a las 10:09

La tecnología no es totalitaria. Puede haber gobiernos totalitarios que empleen la tecnología para sus fines contrarios a derecho. Pero no es la tecnología la culpable. En este caso, concuerdo que se debe discutir más el tema, y se debe legislar sobre los usos que se le puede dar, y sobre el mecanismo a seguir para su aplicación. Lo que si sería totalitaro, sería simplemente pedir que no se apruebe la creación y la posibilidad de uso.